GDDR7作为显存领域的革命性产品,自2024年3月JEDEC(固态存储协会)发布其正式标准和规范后,GDDR7其正以高性能特性在越来越多的人工智能应用场景中发挥积极作用。

集微网日前就“GDDR7赋能AI推理”话题与Rambus半导体IP产品管理总监Nidish Kamath作交流,探讨其面对新一代技术标准的前瞻观点,以及如何塑造AI 2.0世界。

AI推理堆高内存挑战

人工智能浪潮之下,GPT-4在内大型语言模型(LLM),正以日趋复杂的特性对现有内存技术构成重大挑战,要求更大的容量、更高的带宽、更低的延迟以及更优的能效。Nidish Kamath认为,AI的进一步成熟将对内存提出更多诉求,而核心挑战是提供更高性能的同时实现更佳能效。内存与互连技术将在此扮演关键角色,如果处理器要运行得更快,那么也必须同样地加速数据传输。

另一个关键挑战是,在处理器与内存之间,以及处理器与处理器之间的通道和链路上,以更高数据速率实现可靠的数据传输,这是新技术大有可为的领域——Multi-PAM信令技术就是可能被采用以支持数据速率持续提升的一个技术范例。

而对于内存可靠性而言,提升单芯片的比特密度也是一项挑战。因为随着存储单元微缩以在芯片上容纳更多比特,需要管控其他一些效应,其中包括片上错误;此外,还需应对诸如“RowHammer”和“RowPress”等其他效应,在这些效应下,对特定单元的访问可能会干扰邻近区域的单元。

在此背景下,业界开始关注新一代GDDR技术。根据JEDEC 发布的标准和规范,GDDR7规范可提供高达每引脚48 Gbps的速度(远高于GDDR6和GDDR6X的24 Gbps),以及每设备192 GB/s的带宽。除游戏领域,GDDR已成为AI加速器和GPU的重要解决方案,用以处理AI推理等要求严苛的工作负载,最新一代的GPU和AI系统正利用GDDR7满足这些高级应用的性能需求。

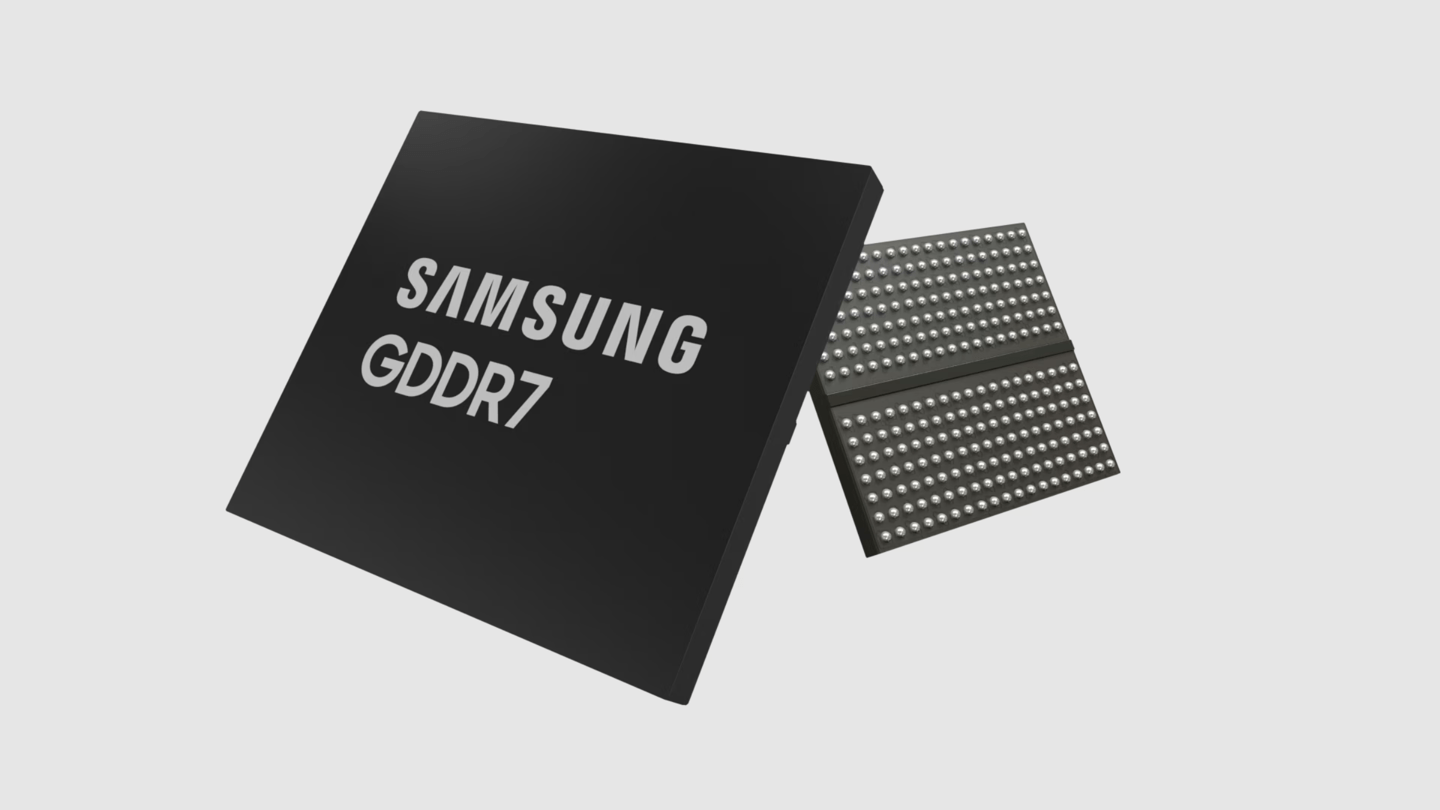

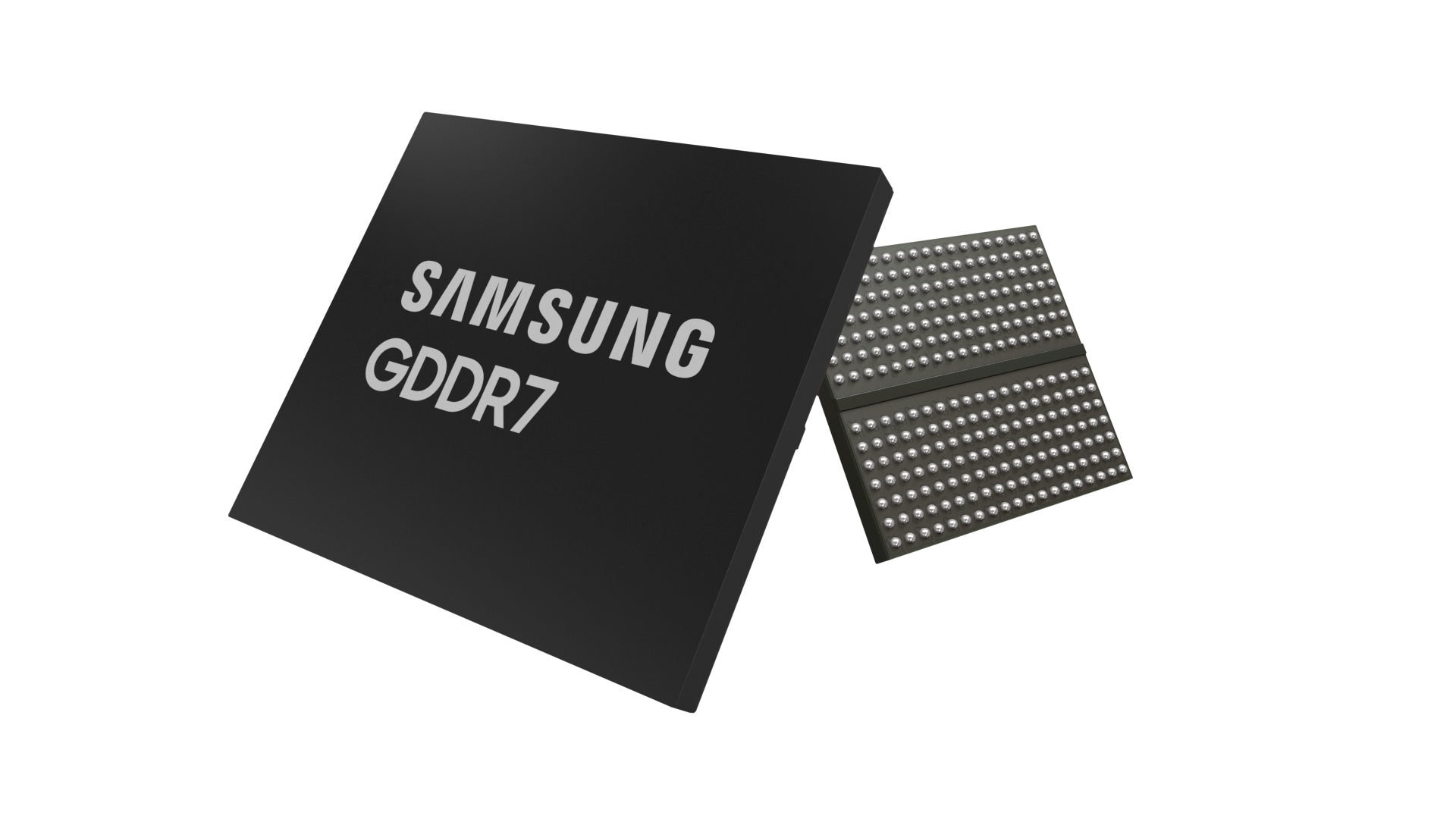

眼下,GDDR7正获得广泛的市场应用,三星(Samsung)和美光(Micron)等内存供应商已推出GDDR7产品。2024年,三星宣布已开发出业界首款24Gb GDDR7 DRAM,该产品还采用脉冲幅度调制(PAM3)信号技术,使其速度在图形DRAM中达到40Gbps,与前代产品相比提高25%。

随着AI推理应用日益普及,并从数据中心扩展至边缘及端点设备,整个计算领域都需要更强大的处理引擎,以及为其量身定制的高性能内存解决方案。

“GPU向来是首选的推理引擎,在服务器和台式机等边缘与终端应用中,这些GPU过去一直使用GDDR6内存。然而,GDDR6在24 Gbps的数据速率下已达到标准NRZ信令的实际极限,”Nidish Kamath强调,为满足未来GPU的带宽需求,采用全新信令方案的新一代GDDR势在必行——应用PAM3信令的GDDR7内存应运而生,可将数据速率一举提升至40 Gbps乃至更高水平。

巨头加持GDDR7走势向好

那么,哪些应用有望率先采用GDDR7?Nidish Kamath向集微网表示,至少AI/ML、数据中心和云计算、汽车行业、高性能计算等领域将率先看到GDDR7发挥作用:

① AI/ML:AI与ML应用需要高速处理海量数据集。GDDR7所提升的性能将有助于加速AI模型的训练与推理过程。随着AI在电信、机器人、汽车等领域的应用不断扩展,GDDR7的重要性将愈发凸显。

② 数据中心和云计算:随着全球云服务需求的持续增长,数据中心需要更高效、更快速的内存解决方案。GDDR7将在增强服务器性能方面扮演关键角色,从而提升云计算服务的效率与可靠性。

③ 汽车行业:对于处理自动驾驶汽车中传感器和摄像头所产生的海量数据而言,GDDR7将至关重要,它能有效提升车辆的决策能力与整体安全性。

④ 高性能计算:科学模拟、金融建模及其他HPC应用都需要强大的计算能力。GDDR7的卓越性能可为用于科学研究、模拟和复杂计算的HPC系统带来显著助益。

市调机构认为,2025年,三星将持续于GDDR7生产时程与产能扩充领先,市占率高达70%,英伟达亦对三星制造的GDDR7高度依赖。在这种供应格局下,预期未来GDDR7价格波动幅度将会收敛,走势呈现持平或小幅上涨。

AI 2.0浪潮中的GDDR7

显而易见,GDDR7的广泛采用将有助于降低AI推理延迟,以其增强的内存容量和带宽支持更大、更复杂的模型,并改善内存系统的能效。面对这一重要技术,Rambus推出了GDDR7内存控制器IP,提供业界领先的GDDR7性能,每引脚速率高达40 Gbps,每个GDDR7内存设备可提供160 GB/s的可用带宽。

Nidish Kamath介绍,Rambus的GDDR7控制器核专为需要高内存吞吐量、高时钟频率和完全可编程性的应用而设计。该控制器核通过AXI接口或简单的本地接口接受命令,并将其转换为GDDR7 SGRAM设备所需的命令序列,也支持所有低功耗模式。

此外,该核心使用先进调度算法来重新排序队列中的用户请求,以此最大限度地提高总线效率,并减少DRAM访问规则造成的内存总线空闲时间。核心在维持访问限制和一致性规则的同时,会选择处理队列中的下一个最佳请求,以此实现高效率,并将所有请求的延迟时间降至最低。

最后,Nidish Kamath以Rambus的角度谈了内存技术的未来发展:“伴随全球AI‘民主化’趋势的不断发展,许多AI应用正从数据中心扩展至边缘和端点,这对现有内存系统在带宽、延迟、容量等方面提出了日益增长的需求。在AI 2.0的演进浪潮中,Rambus在内存接口芯片、内存接口IP和安全IP解决方案方面具有深厚的专业知识,正与行业伙伴紧密合作,共同开发尖端的内存解决方案,以完全释放人工智能技术的巨大潜力。”