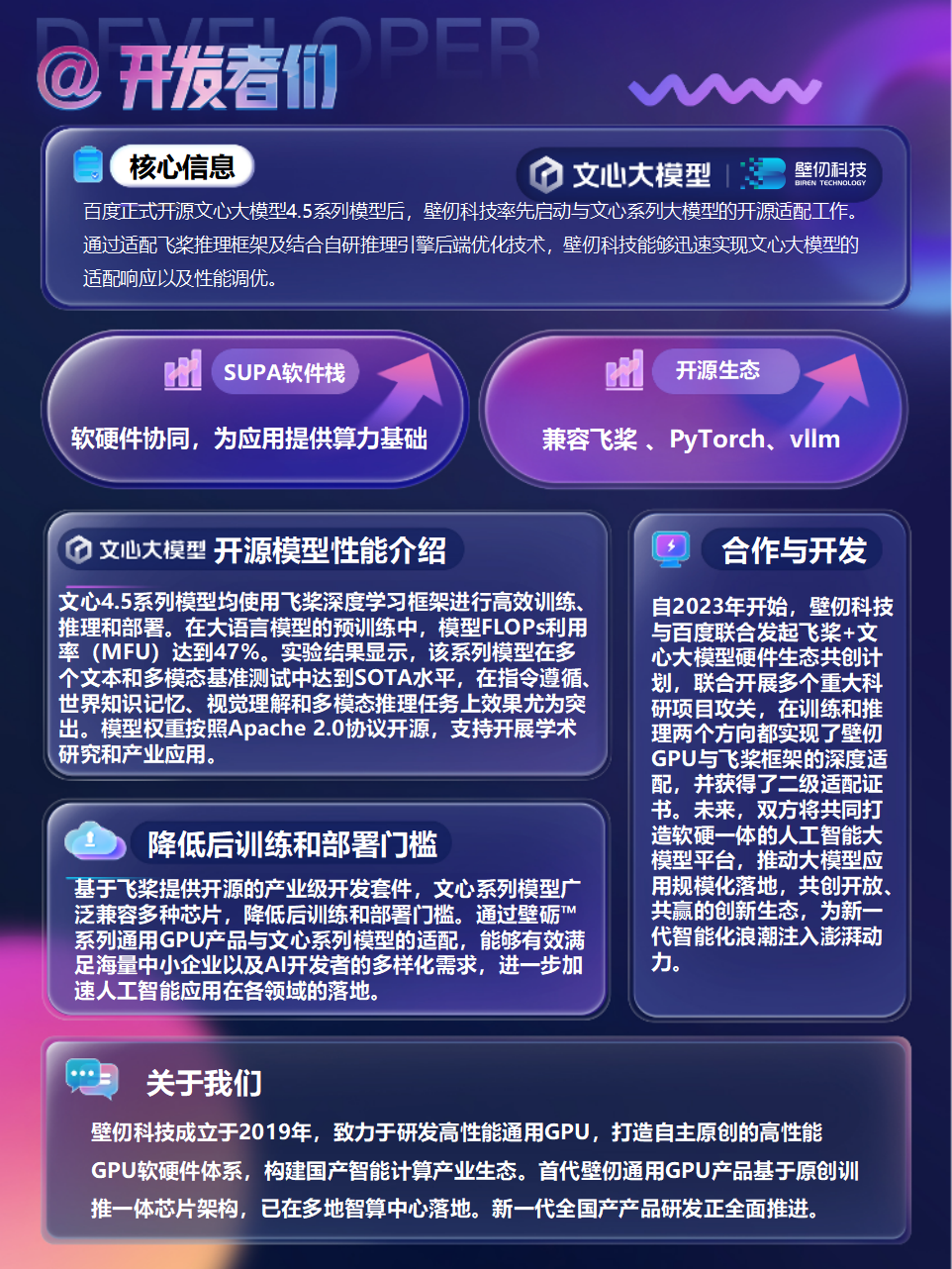

6月30日,百度正式开源文心大模型4.5系列模型后,壁仞科技率先启动与文心系列大模型的开源适配工作。通过适配飞桨推理框架及结合自研推理引擎后端优化技术,壁仞科技能够迅速实现文心大模型的适配响应以及性能调优。

文心4.5系列开源模型共10款,涵盖了激活参数规模分别为47B和3B的混合专家(MoE)模型(最大的模型总参数量为424B),以及0.3B的稠密参数模型。

文心4.5系列模型均使用飞桨深度学习框架进行高效训练、推理和部署。在大语言模型的预训练中,模型FLOPs利用率(MFU)达到47%。实验结果显示,该系列模型在多个文本和多模态基准测试中达到SOTA水平,在指令遵循、世界知识记忆、视觉理解和多模态推理任务上效果尤为突出。模型权重按照Apache 2.0协议开源,支持开展学术研究和产业应用。

壁仞科技依托自研的壁砺™系列通用GPU架构与深度优化的软件栈,从而实现对文心系列模型的适配。壁砺™系列产品可广泛用于大语言、多模态、图像识别、推荐等场景,支持预训练、微调、推理等使用方式,不仅能够与主流AI生态无缝兼容,0成本迁移适配,还能够通过灵活可控的多机多卡集群扩展能力,全方位支持千亿及以下不同规格参数量模型,为全行业的各类业务场景提供极具性价比的产品方案。

基于飞桨提供开源的产业级开发套件,文心系列模型广泛兼容多种芯片,降低后训练和部署门槛。这也意味着,通过壁砺™系列通用GPU产品与文心系列模型的适配,能够有效满足海量中小企业以及AI开发者的多样化需求,进一步加速人工智能应用在各领域的落地。

值得一提的是,自2023年开始,壁仞科技与百度联合发起飞桨+文心大模型硬件生态共创计划,联合开展多个重大科研项目攻关,在训练和推理两个方向都实现了壁仞GPU与飞桨框架的深度适配,并获得了二级适配证书。未来,双方将共同打造软硬一体的人工智能大模型平台,推动大模型应用规模化落地,共创开放、共赢的创新生态,为新一代智能化浪潮注入澎湃动力。