AI PC市场的爆发正在引发一场静悄悄的内存革命。据IDC预测,全球AI PC出货量将从2024年的5000万台猛增至2027年的1.67亿台,占据近60%的PC市场份额。这一增长背后是AI大模型参数规模每年超10倍的膨胀——从GPT-3的1750亿参数到GPT-4的1.8万亿,短短几年规模增长超400倍。当这些百亿级参数的大模型从云端下沉至PC端运行时,内存带宽与能效瞬间成为制约性能的关键瓶颈。

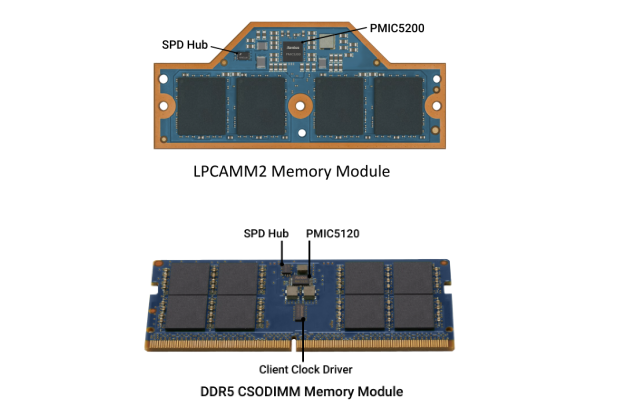

在此背景下,Rambus于2025年5月推出两款划时代的电源管理芯片(PMIC):专为LPDDR5 LPCAMM2模块设计的PMIC5200,以及面向DDR5 CSODIMM/CUDIMM模块的PMIC5120。它们与客户端时钟驱动器(CKD)、串行检测(SPD)集线器协同,构成业界首个覆盖所有JEDEC标准DDR5/LPDDR5内存模块的完整芯片组解决方案。这一创新不仅突破了现有AI PC的内存性能边界,更重新定义了从超薄笔记本到高性能工作站的内存架构范式。

技术创新:破解AI PC的内存效能困局

传统PC内存架构在AI负载面前暴露出两大致命缺陷。一方面,为追求低功耗而焊接在主板上的LPDDR5内存,牺牲了可升级性,用户无法随AI软件需求灵活扩容;另一方面,DDR5模块在高频运行时易受信号抖动和电压波动干扰,导致数据传输错误率飙升——当速率突破7200 MT/s时,电源噪声每增加1毫伏,误码率可能呈指数级上升。

Rambus的破局之道在于芯片组级协同设计:

PMIC5200 针对移动端LPCAMM2模块,通过>95%的电压转换效率将功耗压至新低,同时支持未来10.7 GT/s速率,为端侧AI推理预留带宽空间。其与SPD Hub的联动首次实现LPDDR5内存可插拔设计,用户可像更换SODIMM一样升级笔记本内存。

PMIC5120 则为台式机/工作站而生,提供200%过压保护与增强电流输出,确保DDR5在7200 MT/s高频下仍保持稳定电压。配合CKD芯片对时钟信号的抖动抑制,整个系统在纳秒级负载突变中仍维持误码率低于10⁻¹⁶。

这种“供电-信号-散热”三位一体的设计,使OEM厂商能按需匹配方案:超薄本采用LPCAMM2获得性能与续航平衡;创作者工作站选用CUDIMM释放极致带宽;紧凑型主机则借CSODIMM优化空间利用率。

产业共振:从芯片到生态的协同进化

Rambus的芯片组价值远超出硬件本身——它正在重塑AI PC内存产业链的协作模式。美光已宣布在其下一代LPCAMM2模块中集成PMIC5200,称其“突破内存性能边界”;英特尔则确认搭载Core Ultra处理器的AI PC将采用该方案,以支撑本地运行70亿参数大模型的需求。

更深层的变革在于成本与普及路径的优化。当前AI PC售价普遍高于常规机型(高端机型达2-4万元),84%用户表示不愿为AI功能额外付费。而Rambus的预认证芯片组可缩短模块开发周期6个月以上,加速产品上市。随着高通宣布2025年推出700美元级AI PC终端,英特尔、AMD跟进降价,内存模块的标准化与成本控制将成为渗透率跃升的关键支点。

值得关注的是,这场变革正与处理器架构转型交汇。Arm阵营凭借每瓦性能优势,在AI PC领域快速扩张——预计Windows on Arm设备出货量将从2024年的200万台飙升至2026年的3000万台。Rambus芯片组对多架构的兼容性,使其在x86与Arm的生态竞合中成为“中立基础设施”。

未来图景:内存技术如何定义AI PC体验边界

当AI从工具演进为个人智能体,内存子系统将承担更复杂的实时决策任务。生成式AI的多模态交互(如语音/眼动追踪)要求内存延迟低于5纳秒;而端侧持续学习的实现,需内存带宽在现有基础上再提升3倍以支持千亿参数模型。

Rambus的布局已延伸至更前沿场景:

HBM4控制器IP 已实现1.64TB/s带宽,为未来搭载NPU+GPU融合架构的AI PC铺路;

多层级供电网络 通过分布式稳压设计将噪声降低40%,应对DDR5-8000时代更严苛的电源完整性挑战;

温度感知动态调频技术让SPD Hub实时调节功耗,避免高负载下因过热触发降频。

这些技术将直接转化为用户体验跃升:设计师在本地渲染3D模型时不再因内存瓶颈卡顿;游戏本续航从8小时延至24小时;程序员可离线调试百亿参数代码生成模型——正如IDC分析师Brandon Hoff所言:“先进内存接口芯片是释放AI潜力的钥匙”。

结语

当AI PC的聚光灯长期聚焦于CPU与NPU,Rambus用这套芯片组揭示了被忽视的真相:内存带宽的枷锁不打破,再强的算力引擎也无法全速运转。其价值不仅在于当前支持6400-7200 MT/s的速率,更在于为未来万兆传输时代铺设了可进化的基础设施。

随着2025年底首批搭载LPCAMM2的笔记本量产,消费者将亲历一场“无感升级”——他们不会看到PMIC芯片上精密的电压反馈环路,但能感受到超薄本在运行AI视频剪辑时依旧凉爽安静;他们无需理解SPD Hub如何协调信号时序,却可享受更换内存条5分钟完成性能跃迁的便捷。这种“隐形赋能”,恰是底层技术创新的终极意义。